La ley de Moore es uno de los conceptos más conocidos de la historia de la tecnología. Aunque se llama ley, no se trata de una ley natural como la gravedad. En cambio, es una observación sobre cómo han evolucionado los chips informáticos con el tiempo. La idea se formuló en la década de 1960 y llegó a marcar a toda la industria electrónica durante décadas. Para los principiantes, la ley de Moore puede parecer un tema técnico, pero en la práctica trata de algo muy concreto: por qué los ordenadores, los teléfonos y muchos otros productos digitales se volvieron más rápidos, más pequeños y más baratos durante un largo período.

Cuando se entiende la ley de Moore, también se entiende una parte importante del desarrollo de la tecnología moderna. Explica por qué un smartphone común hoy puede realizar tareas que antes requerían ordenadores grandes y costosos. Al mismo tiempo, el concepto ayuda a explicar por qué la industria de los chips se enfrenta ahora a nuevos desafíos. Por eso, la ley de Moore es tanto una referencia histórica como una clave para comprender las limitaciones y posibilidades tecnológicas actuales.

La ley de Moore proviene de Gordon Moore, quien fue cofundador de Intel. En 1965, observó que el número de transistores en un circuito integrado tendía a duplicarse a intervalos regulares. Un transistor es un componente electrónico muy pequeño que funciona como una especie de interruptor o amplificador en los circuitos digitales. Cuantos más transistores se puedan colocar en un chip, más cálculos puede realizar normalmente ese chip. La observación original de Moore apuntaba a una duplicación aproximadamente cada año, pero más tarde se habló a menudo de una duplicación aproximadamente cada dos años.

Lo importante de la ley de Moore no es solo la cifra en sí, sino la consecuencia de esta evolución. Si el número de transistores aumenta de forma rápida y regular, los fabricantes pueden construir procesadores más avanzados sin hacerlos proporcionalmente más grandes. Eso significó durante muchos años que los ordenadores se volvieran más potentes, al mismo tiempo que el precio por cálculo disminuía. Por ello, la tecnología se volvió más accesible tanto para las empresas como para los consumidores comunes. Con el tiempo, la ley de Moore se convirtió casi en un plan para toda la industria, porque muchas empresas adaptaron su investigación, producción y expectativas a ella.

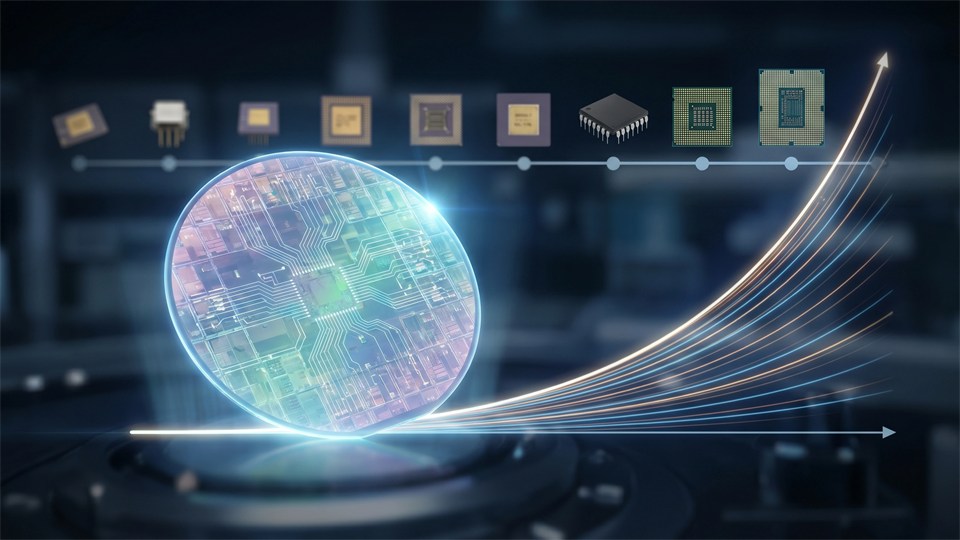

Antes de los circuitos integrados y de la producción moderna de chips, la electrónica ocupaba mucho más espacio. Los ordenadores podían ser tan grandes como habitaciones o armarios, y requerían recursos considerables para construirse y funcionar. Cuando fue posible reunir cada vez más transistores en un mismo chip, cambió por completo la relación entre tamaño, precio y rendimiento. Un chip más pequeño podía realizar más trabajo que una solución mucho mayor de una generación anterior. Eso hizo que los ordenadores fueran más prácticos, más eficientes energéticamente y más fáciles de producir en masa.

Para los usuarios comunes, esto significó, entre otras cosas, que los ordenadores personales se volvieran realistas. Más tarde, los ordenadores portátiles, los teléfonos móviles, las cámaras digitales, las consolas de videojuegos y los dispositivos inteligentes fueron posibles en la forma que conocemos. Si la potencia de procesamiento hubiera seguido siendo cara y voluminosa, muchos de estos productos habrían sido muy limitados o ni siquiera habrían existido. Por eso, la ley de Moore no fue solo un detalle técnico para ingenieros. Se convirtió en una fuerza impulsora de la digitalización en el hogar, en el lugar de trabajo, en la investigación, en la comunicación y en el entretenimiento.

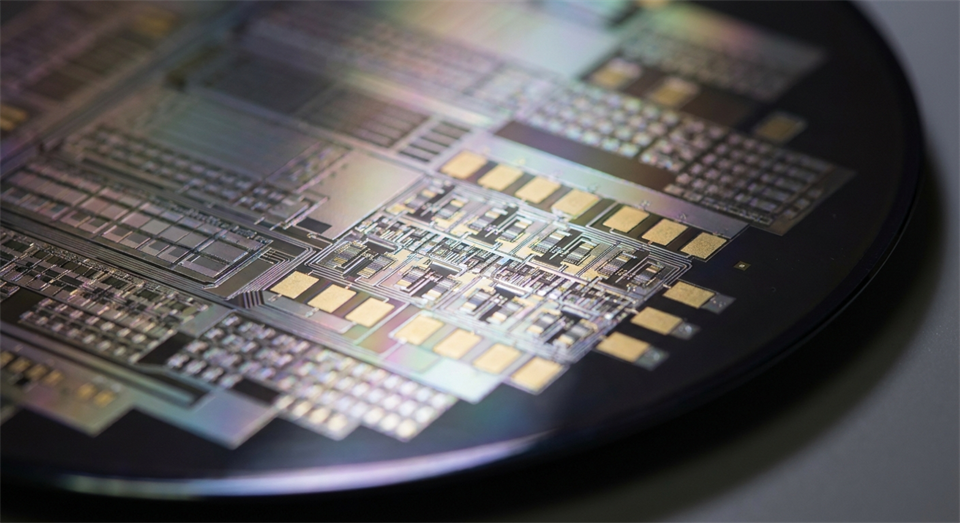

Para entender la ley de Moore, es útil conocer la relación entre transistores y chips. Un chip informático, a menudo llamado microchip o procesador, está compuesto por enormes cantidades de transistores diminutos conectados en patrones complejos. Estos transistores pueden encender y apagar señales eléctricas y, de ese modo, representar los valores binarios 0 y 1 en los que se basa la electrónica digital. Cuando millones o miles de millones de transistores trabajan juntos, pueden realizar operaciones lógicas, almacenar datos temporales y controlar programas avanzados.

Si se pueden hacer los transistores más pequeños, se pueden colocar más de ellos en la misma superficie. Eso ofrece más posibilidades para aumentar la funcionalidad de un chip. Por ejemplo, un procesador puede tener más núcleos, una caché mayor o unidades de control más avanzadas. Al mismo tiempo, las señales a menudo pueden recorrer distancias más cortas dentro del chip, lo que puede mejorar la velocidad. En la práctica, la miniaturización fue por tanto una de las razones más importantes por las que los ordenadores se volvieron más rápidos con el tiempo. La ley de Moore se convirtió en un símbolo de esta miniaturización y de la mejora continua de los circuitos integrados.

Durante muchos años, casi se podía notar la ley de Moore en la vida cotidiana. Un ordenador nuevo se sentía claramente más rápido que el modelo de unos pocos años antes. Los programas que antes tardaban mucho en abrirse se volvieron más ágiles. Los gráficos de los videojuegos se hicieron más detallados. El procesamiento de imágenes, la edición de vídeo y otras tareas exigentes se volvieron gradualmente posibles en máquinas de consumo comunes. Lo mismo ocurrió en el mundo móvil, donde los teléfonos evolucionaron de simples dispositivos de comunicación a pequeños ordenadores con cámara, GPS, internet e inteligencia artificial.

Las empresas también utilizaron esta evolución como base para la planificación. Los desarrolladores de software podían contar con que los ordenadores del futuro tendrían más potencia de cálculo y más memoria. Eso hizo posible crear programas más avanzados y sistemas de datos más grandes. Al mismo tiempo, la caída del precio por transistor significó que la electrónica pudiera integrarse en más tipos de productos. Por eso, los ordenadores llegaron a los coches, los electrodomésticos, los equipos médicos, los robots industriales y los equipos de red. De ese modo, la ley de Moore ayudó a extender la tecnología digital mucho más allá del ordenador clásico.

La respuesta corta es: sí y no. Durante muchos años, la evolución coincidió más o menos con la ley de Moore, pero con el tiempo se ha vuelto más difícil y más caro continuar al mismo ritmo. Cuando los transistores se vuelven extremadamente pequeños, surgen problemas físicos y técnicos. Los materiales se comportan de manera diferente a escalas muy pequeñas, el calor se convierte en un problema mayor y la producción requiere equipos cada vez más avanzados. Eso significa que ya no es tan fácil duplicar el número de transistores a la misma velocidad que antes.

Por eso, muchos dicen que la ley de Moore está perdiendo fuerza o cambiando de carácter. Sin embargo, eso no significa que el desarrollo se haya detenido. Los fabricantes de chips siguen mejorando sus productos, pero los avances no provienen solo de hacer los transistores más pequeños. En su lugar, también se trabaja con mejores arquitecturas, más núcleos de procesador, circuitos especializados y software más inteligente. Así, un chip moderno puede volverse más rápido sin seguir necesariamente con exactitud la versión clásica de la ley de Moore. El concepto sigue siendo útil, pero ya no describe por sí solo todo el panorama.

Una razón importante es la física. Cuando los transistores se vuelven tan pequeños que sus dimensiones se acercan a unos pocos nanómetros, resulta más difícil controlar los electrones con precisión. Pequeñas variaciones en los materiales y en la producción pueden tener una gran importancia para el resultado. Además, la generación de calor se convierte en un desafío central. Incluso si se pueden empaquetar más transistores en un chip, no es seguro que se pueda hacer que todos trabajen rápidamente sin generar demasiado calor o consumir demasiada energía.

Otra razón es la economía. Las fábricas de producción moderna de chips están entre las instalaciones industriales más caras del mundo. Las máquinas son extremadamente avanzadas, y el desarrollo de nuevos procesos de producción requiere inversiones enormes. Eso significa que solo unas pocas empresas pueden permitirse estar realmente a la vanguardia. La ley de Moore trataba originalmente del desarrollo tecnológico, pero hoy la economía es casi tan importante como la física. Incluso si algo es posible en el laboratorio, no significa necesariamente que pueda producirse a un coste lo bastante bajo para el mercado masivo.

Cuando la miniaturización ya no puede impulsar por sí sola el progreso, la industria busca otros caminos. Un método consiste en crear chips especializados para tareas concretas. En lugar de que un solo procesador tenga que ser el mejor en todo, se pueden usar distintos tipos de circuitos para gráficos, inteligencia artificial, procesamiento de señales o cifrado. Esa es una de las razones por las que los ordenadores y teléfonos modernos suelen contener varias unidades de procesamiento diferentes que trabajan juntas. Esta especialización puede aportar grandes beneficios en rendimiento y eficiencia energética.

Otra dirección es el llamado diseño con chiplets, en el que un procesador se construye a partir de varias partes más pequeñas en lugar de un gran chip monolítico. Esto puede hacer que la producción sea más flexible y mejorar el rendimiento de fabricación en la planta. Además, la industria trabaja con el empaquetado 3D, en el que los componentes se apilan más estrechamente para ahorrar espacio y acortar las conexiones. El software también desempeña un papel mayor que antes. Mejores compiladores, algoritmos más inteligentes y un uso más eficiente del hardware pueden aportar mejoras perceptibles, incluso cuando el crecimiento bruto del número de transistores se ralentiza.

Aunque la evolución ha cambiado, la ley de Moore sigue siendo un concepto importante porque explica cómo el mundo digital alcanzó su nivel actual. Muchas de las tecnologías que hoy damos por sentadas fueron posibles porque la industria de los chips pudo ofrecer durante décadas una capacidad de cálculo cada vez mayor a menor precio. Esto se aplica a todo, desde la expansión de internet y los centros de datos hasta los smartphones, la navegación, el streaming y los equipos médicos modernos. Sin este largo período de mejora rápida, la infraestructura digital habría sido completamente diferente.

La ley de Moore también es relevante como recordatorio de que el progreso tecnológico no continúa automáticamente al mismo ritmo para siempre. Muchas personas se acostumbraron a contar con que la siguiente generación de hardware casi por sí sola resolvería los problemas de velocidad y capacidad. Hoy, el progreso suele requerir más creatividad, mejor diseño y mayores inversiones. Por eso, conocer la ley de Moore aporta tanto comprensión histórica como una visión más realista de la tecnología del futuro.

La ley de Moore comenzó como una observación sobre el número de transistores en los chips, pero llegó a simbolizar todo el desarrollo explosivo de la tecnología informática durante varias décadas. Ayudó a explicar por qué la electrónica se volvió más pequeña, más barata y más potente, y por qué los productos digitales se extendieron a casi todos los ámbitos de la sociedad. Para los principiantes, es una clave útil para entender cómo fue posible la tecnología moderna.

Hoy, el desarrollo clásico ya no es tan sencillo como antes, porque tanto los límites físicos como los económicos desempeñan un papel mayor. Aun así, el legado de la ley de Moore sigue vivo en la forma en que la industria de los chips piensa la innovación. Puede que los avances del futuro no provengan solo de transistores más pequeños, sino también de nuevos diseños, chips especializados y software más inteligente. Por eso, la ley de Moore sigue mereciendo ser conocida: no como una garantía eterna, sino como una explicación central del mundo tecnológico en el que vivimos.